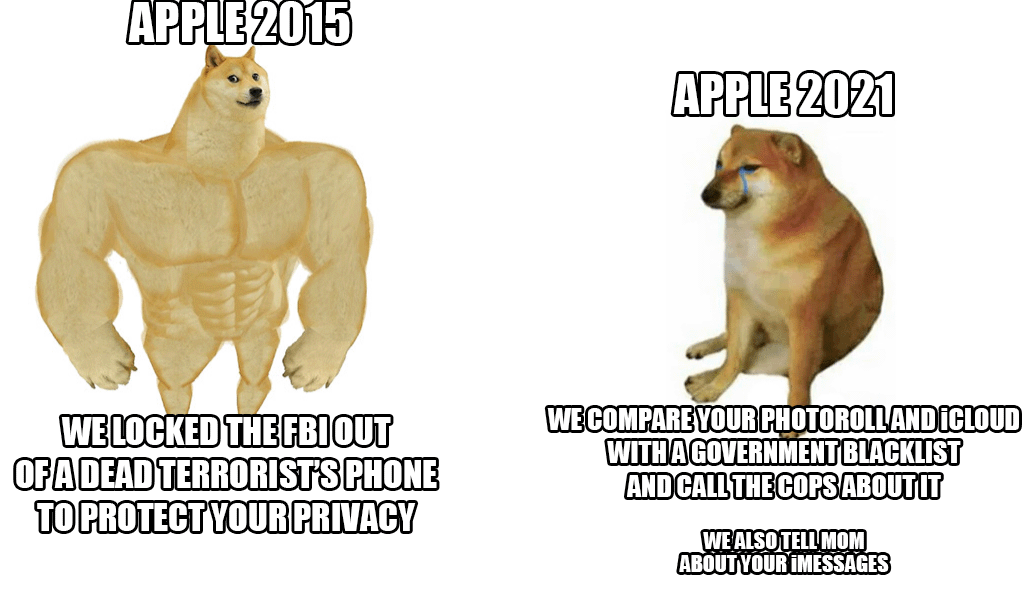

पिछले सप्ताह के अंत में, हमने आपको एक दिलचस्प नवीनता के बारे में सूचित किया था, जो बाल दुर्व्यवहार को दर्शाने वाली छवियों का पता लगाने के लिए एक नई प्रणाली है। विशेष रूप से, Apple iCloud पर संग्रहीत सभी फ़ोटो को स्कैन करेगा और पता चलने पर, इन मामलों की रिपोर्ट संबंधित अधिकारियों को करेगा। यद्यपि सिस्टम डिवाइस के भीतर "सुरक्षित रूप से" काम करता है, फिर भी गोपनीयता का उल्लंघन करने के लिए विशाल की आलोचना की गई, जिसकी घोषणा लोकप्रिय व्हिसलब्लोअर एडवर्ड स्नोडेन ने भी की थी।

यह हो सकता था रुचि आपको

समस्या यह है कि Apple अब तक अपने उपयोगकर्ताओं की गोपनीयता पर निर्भर रहा है, जिसे वह हर परिस्थिति में सुरक्षित रखना चाहता है। लेकिन यह खबर सीधे तौर पर उनके मूल रवैये को बाधित करती है. सेब उत्पादकों को वास्तव में असफलता का सामना करना पड़ता है और उन्हें दो विकल्पों में से एक को चुनना पड़ता है। या तो उनके पास iCloud पर संग्रहीत सभी चित्रों को स्कैन करने वाला एक विशेष सिस्टम होगा, या वे iCloud फ़ोटो का उपयोग बंद कर देंगे। तब पूरी चीज़ काफी सरलता से काम करेगी। iPhone हैश का एक डेटाबेस डाउनलोड करेगा और फिर तस्वीरों के साथ उनकी तुलना करेगा। साथ ही, यह उन खबरों में भी हस्तक्षेप करेगा, जहां इसका उद्देश्य बच्चों की सुरक्षा करना और माता-पिता को जोखिम भरे व्यवहार के बारे में समय पर सूचित करना है। चिंताएं इस तथ्य से उत्पन्न होती हैं कि कोई व्यक्ति डेटाबेस का दुरुपयोग कर सकता है, या इससे भी बदतर, सिस्टम न केवल फ़ोटो, बल्कि संदेश और सभी गतिविधि को भी स्कैन कर सकता है, उदाहरण के लिए।

बेशक, Apple को जितनी जल्दी हो सके आलोचना का जवाब देना था। इस कारण से, उदाहरण के लिए, इसने एक FAQ दस्तावेज़ जारी किया और अब पुष्टि की है कि सिस्टम केवल फ़ोटो स्कैन करेगा, लेकिन वीडियो नहीं। वे इसे अन्य तकनीकी दिग्गजों द्वारा उपयोग किए जा रहे संस्करण की तुलना में अधिक गोपनीयता-अनुकूल संस्करण के रूप में भी वर्णित करते हैं। साथ ही, ऐप्पल कंपनी ने और भी अधिक सटीक रूप से बताया कि पूरी चीज़ वास्तव में कैसे काम करेगी। यदि आईक्लाउड पर छवियों के साथ डेटाबेस की तुलना करते समय कोई मेल होता है, तो उस तथ्य के लिए एक क्रिप्टोग्राफ़िक रूप से सुरक्षित वाउचर बनाया जाता है।

जैसा कि पहले ही ऊपर उल्लेख किया गया है, सिस्टम को बायपास करना भी अपेक्षाकृत आसान होगा, जिसकी पुष्टि सीधे Apple ने की थी। उस स्थिति में, बस iCloud पर फ़ोटो अक्षम करें, जिससे सत्यापन प्रक्रिया को बायपास करना आसान हो जाता है। लेकिन एक सवाल उठता है. क्या यह इस लायक है? किसी भी मामले में, अच्छी खबर यह है कि यह प्रणाली कम से कम अभी तक केवल संयुक्त राज्य अमेरिका में ही लागू की जा रही है। आप इस व्यवस्था को किस प्रकार देखते हैं? क्या आप इसे यूरोपीय संघ के देशों में लागू करने के पक्ष में होंगे, या यह निजता में बहुत अधिक घुसपैठ है?

खैर, यह जटिल है. निजता की सुरक्षा निश्चित रूप से बाकी सभी चीजों से ऊपर है। यह भी एक कारण है कि मैं इस प्लेटफ़ॉर्म का उपयोग करता हूं। लेकिन हर चीज़ की अपनी सीमाएं होती हैं. संक्षेप में, प्रत्येक स्वतंत्रता वहीं समाप्त हो जाती है जहां वह किसी और की स्वतंत्रता का उल्लंघन करती है। यह स्पष्ट है कि जो कोई भी बच्चों को नुकसान पहुंचाने या उनके साथ दुर्व्यवहार करने को तैयार है, उसके खिलाफ कार्रवाई की जानी चाहिए। वह बिना बहस के है।

जैसा कि पहले ही ऊपर उल्लेख किया गया है, सिस्टम को बायपास करना भी अपेक्षाकृत आसान होगा, जिसकी पुष्टि सीधे Apple ने की थी। उस स्थिति में, बस iCloud पर फ़ोटो अक्षम करें, जिससे सत्यापन प्रक्रिया को बायपास करना आसान हो जाता है।

उसी समय Coz का अर्थ है साझा एल्बम को बंद करना। कितना सरल प्रिय वॉटसन :)

निर्दिष्ट प्राधिकारी की अनुमति के बिना फ़ोटो को स्वचालित रूप से खंगालना सैद्धांतिक रूप से गलत है, और मैं आपसे शर्त लगाता हूँ कि यह केवल पहला कदम है। ऐसी बहुत सी चीजें हैं जो की जा सकती हैं जो पहले तो उचित हैं और फिर इसे रोका नहीं जा सकता बाल अश्लीलता-> सफेद मांस का व्यापार-> पशु क्रूरता -> ड्राइविंग पर ध्यान न देना -> विपक्षी दलों के कार्यक्रमों में भागीदारी ...

समस्या वह है जो इस प्रक्रिया को संभव बनाती है। फ़ोन और OS निर्माता को एक उपयोगकर्ता के रूप में हमें यह क्यों बताना पड़ता है कि इसमें क्या होना चाहिए? बेशक, विशेष रूप से सही बच्चों के लिए, यह सुनना बहुत अच्छा लगता है, इसलिए Apple एक अत्याधुनिक उपकरण भी प्रायोजित करता है जो इस मुद्दे से निपटता है। गैर-लाभकारी संस्थाएं इसका समाधान क्यों करती हैं, क्योंकि बच्चों को राज्य में कोई दिलचस्पी नहीं है? अगर मैं कुछ भी गलत नहीं कर रहा हूं तो इससे मुझे वास्तव में कोई परेशानी नहीं है, लेकिन वे प्रत्येक iPhone/iPad उपयोगकर्ता को संभावित अपराधी बना देते हैं। यह विकृत तर्क है, मैं कहूंगा कि सबसे सरल समाधानों में से एक, हम आपकी तस्वीरों को सुरक्षित रूप से स्कैन करेंगे। इसलिए जो कोई भी मुझे iMessage के माध्यम से चाइल्ड पोर्नोग्राफी भेजता है, वह निराश है कि मैं एक अपराधी हूं और मुझे उस चीज़ के लिए एक निजी कंपनी के प्रति जवाबदेह ठहराया जाएगा जिसमें मेरी कोई दिलचस्पी नहीं है और इस बीच मैं लॉग इन नहीं करूंगा क्योंकि आईडी ब्लॉक कर दी जाएगी। और वे सभी निराश लोग जो इतने मूर्ख हैं कि वे अपने बच्चों की तस्वीरें साझा करते हैं और उन्हें क्लाउड पर वापस भेज देते हैं, कहीं और चले जाएंगे क्योंकि सबसे मूर्ख लोग इसकी चपेट में आ जाते हैं। साथ ही कुछ माता-पिता जिन्होंने गलती से पिंडिक/पिपिंका के साथ अपनी संतान की तस्वीर ले ली। बहुत बढ़िया।

वे उन माता-पिता को क्यों पकड़ेंगे जिन्होंने उनकी नग्न संतानों की तस्वीर ली थी? यह उस तरह से काम नहीं करता

हां, मैंने इसे गलत लिखा है, इसलिए संभवतः यह काम नहीं करेगा। और आगे ?